خطرات بالقوه هوش مصنوعی را بیشتر بشناسید

به گزارش خبرنگار حوزه علم، فناوری و دانشبنیان گروه فناوری خبرگزاری آنا، به مناسبت روز جهانی علم در خدمت صلح و توسعه، تنها دو بار استفاده از سلاح اتمی به بشریت نشان داده است که بهکارگیری افسارگسیخته علم میتواند تا چه اندازه خطرناک و خانمانسوز باشد. بمباران اتمی ایالاتمتحده آمریکا علیه ژاپن در شهر ناگازاکی، تمامی موجودات زنده را در شعاع حدود یک و نیم کیلومتری نابود کرد.

بیشتر بخوانید:

علم در خدمت صلح و توسعه/ ارتقای آگاهی عمومی زمینهساز صلح پایدار در جهان است

زمانی که وحشت از این سلاح نابودگر تمام جهان را فراگرفته بود در 1953 برای اولین بار ایجاد چهارچوبی با عنوان «اتم برای صلح» مطرح شد. هدف این بود که توافقی جهانی برای جلوگیری از گسترش سلاحهای اتمی صورت بگیرد. در بمب اتمی عناصری همچون اورانیوم یا پلوتونیوم مورداستفاده قرار میگیرد و برای انفجار، هسته اتم شکافته میشود و هیچچیز نمیتواند جلوی انرژی خارجشده از آن را بگیرد. بااینوجود توافق برای عدم استفاده از سلاح اتمی به معنی عدم استفاده از مصارف صلحآمیز انرژی اتمی نبود.

مفهوم اتم برای صلح، بدین معنی بود که استفاده صلحآمیز کشورها از فناوری هستهای درزمینهٔ انرژی، کشاورزی و دارو و... نهتنها نباید محدود شود بلکه لازم است بیشازپیش مورد تشویق قرار گیرد. هیچکس نمیتواند ادعا کند پروژه اتم برای صلح صد درصد موفقیتآمیز از آب درآمد و توانست بهطور کامل از گسترش فناوری سلاح هستهای جلوگیری کند. جهانیان شاهد بودند که کشورهای نورچشمی بارها قوانین را نقض کردند.

اما درعینحال بسیاری از کشورها توانستند از پروژه اتم برای صلح استفاده کنند و نظمی بینالمللی در سایه پیمان منع گسترش سلاحهای هستهای شکل گرفت تا دنیا امنتر باشد و کشورهای دارای سلاح هستهای همچون آمریکا و روسیه را وادار کرد نسبت به سلاحهای خود مسئولیتپذیر باشند. شاید اگر چنین توافقی صورت نمیگرفت دولتها امروز در هر جنگ منطقهای از سلاح هستهای استفاده میکردند.

عصر هوش مصنوعی

از قضا جهان امروز در مقطعی مشابه در طلوع عصر هوش مصنوعی قرار دارد. بنیاد جهانی چالشها در فهرستی که سال 2015 در مورد 12 خطر اصلی که بشریت را طی صد سال آتی تهدید میکند خطر جنگ بزرگ هستهای را در رتبه ششم قرار داد. تغییرات آب و هوایی در رتبه چهارم جای گرفت و همانطور که احتمالاً حدس زدید از هوش مصنوعی بهعنوان تهدید شماره یک یاد شد.

بنابراین کشورهای جهان لازم است با درس گرفتن از فناوریهای دیگر از همین حالا چارچوبی را برای استفاده از هوش مصنوعی خصوصاً درزمینهٔ تسلیحاتی تدوین کنند.

«هوش مصنوعی برای صلح» چگونه خواهد بود؟ ماهیت هوش مصنوعی متفاوت از فناوری هستهای است اما برخی از مبانی اساسی که در اساسنامه منع گسترش سلاحهای اتمی قرار دارد میتواند برای مقابله با خطرات هوش مصنوعی نیز مفید باشد. دولت، بخش خصوصی و دانشگاه میتوانند باهم در این زمینه همکاری کنند. دانشمندان و تکنسینها در کنار سیاستگذاران و رجال سیاسی در هدایت و اداره این فناوری جدید نقش مهمی دارند.

در سطح دیپلماتیک به اشتراک گذاشتن مزایای صلحآمیز فناوری میتواند کشورها را ترغیب کند تا در برابر ساختاری یکپارچه توافق کنند و حتی کشورهایی که رقیب هستند نیز میتوانند برای ایجاد هنجارهایی برای جلوگیری از گسترش فناوری بیثبات کننده و حتی استفاده از ماژولهایی یکسان به یک نقطه مشترک برسند.

خطرات هوش مصنوعی

عدم اطمینان در مورد عوارض جانبی طولانیمدت هوش مصنوعی، تنظیم قواعد را در مورد آن دشوار میسازد اما تردیدی نیست که این فناوری مستعد است تا از کنترل خارج شود. بهعنوانمثال از مفهوم تکنیکی فناوری میدانیم که این احتمال وجود دارد که از نیمه دوم قرن بیست و یکم به بعد (حدوداً سال 2050) هوش مصنوعی از جنبه هوشمندی از انسان پیشی میگیرد و بهتبع آن تغییراتی بزرگی رخ میدهد که به نظر نمیرسد بیشتر آن تغییرات خوشایند باشند.

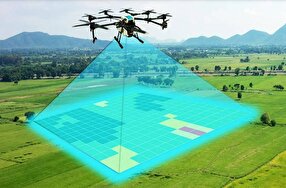

هوش مصنوعی میتواند عوارض فاجعهبار بسیاری داشته باشد. سلاحهای خودکار که وزارت دفاع آمریکا در حال کار کردن روی آن است اساساً ماشینهای بسیار هوشمندی هستند که میتوانند اهداف پنهان را با سرعت بالاتری پیدا کنند و با دقت بیشتری نسبت به سلاحهای سنتی و یا حتی سلاحهای خودکار و نیمهخودکار معمول آنها را مورد هدف قرار دهند.

درحالیکه این فناوری بهطور تدریجی در ستون فقرات اطلاعاتی کشورها گنجانده میشود نسبت به تهدیدات بالقوه آن تحقیق کمی انجامشده است. اگر هوش مصنوعی بدون حسابوکتاب فراگیر شود خدمات بانکی، اداری، تجاری و حتی تولید برق و خدمات بیمارستانها و... بیشتر از قبل آسیبپذیر خواهند شد. شما وقتی به یک دستگاه عابر بانک مراجعه میکنید عملاً با قرار دادن کارتبانکی درون دستگاه، اختیار سرمایه خود را به ماشین دادهاید و ماشین بهعنوان «واسطه» تصمیمهای شما را اجرا میکند.

خوشبختانه تاکنون ماشین هوش مصنوعی فوق هوشمند (superintelligence) ساخته نشده است اما گمانهزنیها در رابطه با آن نشان میدهد هوش مصنوعی میتواند محاسبات استراتژیک را چنان عمق ببخشد که حتی باعث بیثباتی در «کنترل تسلیحات» شود.

چه قواعدی لازم است موردتوجه قرار بگیرد؟

منع گسترش «هوش مصنوعی خطرناک» باید چگونه باشد؟ چه چیزی باید ممنوع شود؟ بهعنوان بدیهیترین قانون لازم است ممنوعیت «ارتکاب قتل» توسط هوش مصنوعی تصویب شود. ماشین حق ندارد برای جان انسان تصمیم بگیرد. در ابعاد بالاتر انسان باید مسئولیت حمله نظامی را خود بر عهده داشته باشد نه هوش مصنوعی.

در تابستان امسال هوش مصنوعی در نبردهای شبیهسازیشده هوایی بر انسان پیروز شد. پنتاگون در وبسایت رسمی خود اعلام کرد که الگوریتم هوش مصنوعی موفق شده است یک خلبان جنگنده باتجربه اف-16 را در شبیهسازی داگفایت (رزم هوایی مستقیم بین دو هواپیمای جنگی) شکست دهد. اگر فکر میکنید دو طرف باهم وارد نبردی طولانی و فرسایشی شدند و نهایتاً هوش مصنوعی بهسختی بر خلبان انسان پیروز شد، دچار اشتباه شدهاید. پیروزی هوش مصنوعی ابداً شکننده نبود. ماشین در حقیقت موفق شد بااقتدار تمام «خلبان نیروی هوایی آمریکا» را طی پنج دور مجزا هر بار در کمتر از دو دقیقه شکست دهد! در حال حاضر این کشور «سطح مناسب قضاوت انسان» را در حملات سلاحهای خودمختار با هدف انسانی ضروری دانسته است اما این اصل بهتنهایی کفایت نمیکند.

بنابراین گام بعدی تعیین این است که «سطح مناسب» قضاوت در کلاسهای خاص فناوری به چه معنی است. برای نمونه کنترل بیشتر انسان ممکن است گاهی نتیجه عکس دهد و از روی اشتباه منجر به کشتار بیشتر شود. از سوی دیگر بسیاری از خطرات هوش مصنوعی از این احتمال سرچشمه میگیرد که تصمیمگیریهای ماشین از طریق کدهای رایانهای اتخاذ میشود و درک این کدها برای انسان میتواند بسیار پیچیده باشد و انسان متوجه نشود که تصمیم در جهت اراده اوست یا تهدیدکننده بشریت.

بنابراین چیزی که در مورد آن تردید نداریم این است که در همه حال باید انسان در رأس امور باشد و ماشین تنها نقش مشاور داشته باشد و حفظ کنترل انسان بر اوضاع در اولویت بالایی قرار دارد.

دسترسی به فناوری صلحآمیز

اینکه بیمقدمه از کشورها بخواهیم در توسعه این فناوری جدید و قدرتمند خود را محدود کنند خیالپردازانه و غیرعملی به نظر میرسد. در موضوع سلاح اتمی خطر اصلی هرچند بسیار بیرحم و خشونتآمیز بود اما همچنان بسیار واضح و ملموس بود. اگر اشتباه کنید در یک ثانیه جان هزاران نفر گرفته میشود. اما هوش مصنوعی بسیار مبهم است و میتواند با پنبه سر ببرد. بهعبارتدیگر معنی خلع سلاح درزمینهٔ هوش مصنوعی هنوز بهطور کامل مشخص نیست.

بااینحال برای ترغیب جهان به اعمال محدودیت در توسعه سلاحهای هوش مصنوعی باید کشورهای توسعهیافته را وادار کرد تا اجازه دسترسی به مزایای هوش مصنوعی برای مصارف مسالمتآمیز را به کشورهای درحالتوسعه بدهند و آنها را در پیشرفتهای فعلی خود شریک کنند. بهعنوانمثال باید برنامههای صلحآمیز و بشردوستانه هوش مصنوعی درزمینهٔ کشاورزی، داروسازی و... با کشورهایی که توافق میکنند هوش مصنوعی را به سمتوسوی خطرناک نکشانند به اشتراک گذاشته شود.

چالش مهم دیگری که باید برای آن تدبیری اندیشیده شود برپایی یک نظام بازرسی منطقی است. تصور اینکه بازرسان سازمانی بینالمللی بخواهند استفاده کشورها از فناوری صلحآمیز هوش مصنوعی را تحت کنترل درآورند به نظر نمیرسد قابل پیادهسازی باشد زیرا فناوریهای رایانهای برخلاف سلاح اتمی هیچ ردپای محسوسی از خود باقی نمیگذارد و اصلاً هیچ موجودیت فیزیکی قابللمسی ندارد و از روی هر رایانهای میتوان آن را توسعه داد. ازاینرو قابل پیشبینی است راهاندازی یک برنامه برای بازرسی و تأیید هوش مصنوعی سودمند زمانبر و جنجالبرانگیز باشد و میتواند به مانعی بزرگ برای استقرار یک سیستم یکپارچه تبدیل شود.

اولین گام در جلب رضایت مسئولان کشورها باید ایجاد اجماع و شناسایی خواستههای سایر دولتها و منافع مشترک بین آنها باشد. هوش مصنوعی نه در مولکولهای اورانیوم بلکه در خطوط و کدهای رایانهای نهفته است. در حال حاضر پروژههای کمابیش منبع باز مثل Open AI برای اشتراکگذاری کتابخانههای هوش مصنوعی وجود دارد اما انتظار اینکه ابرقدرتها کلان دادههای خود را که بهزحمت و از طریق سیستمهای پیشرفته اطلاعاتی و زیرساختهای عظیم حافظه و پردازشی بهدقت آوردهاند، بیهیچ چشمداشتی با بقیه کشورها به اشتراک بگذارند قدری دور از ذهن است و برای آنها نیز لازم است تضمینهای کافی به وجود آید. برای قرار دادن کد هوش مصنوعی در دسترس عموم، اصول شفافیت ممکن است به بازرسی متقابل کمک کند.

هوش مصنوعی برای چهارچوب دفاعی

در حال حاضر تمرکز اصلی روی سلاح است و گفتوگوها در مجامع علمی بیش از همه بر مسئله ممنوعیت سلاحهای خودمختار کُشنده معطوف است. این مبحث بیتردید مسئله مهمی است اما ابداً کفایت نمیکند و نباید دامنه هوش مصنوعی خطرناک را به آن محدود کرد.

انتهای پیام/4144/پ

انتهای پیام/